Wer 2010 in einer mittelgroßen deutschen Stadt arbeitete, kannte den Mann, der die Server in seiner Firma betreute. Wahrscheinlich kannte er ihn beim Vornamen. Wahrscheinlich rief er ihn an, wenn am Freitagnachmittag das Backup nicht durchlief. Und wahrscheinlich kam jemand vorbei, am selben Tag, mit Kabel und Werkzeugkasten und einem Verständnis für genau diese Firma, weil er sie seit Jahren betreute.

Geh heute durch dieselbe Stadt. Die Werkstatt, die das Schild „EDV und Netzwerk“ am Fenster hatte, ist ein Friseur. Das Systemhaus zwei Straßen weiter ist als Bürogemeinschaft an einen Steuerberater verpachtet. Der Mann, der vorbeikam, ist mit fünfundfünfzig in den Vorruhestand gegangen oder bei einem MSP angestellt, der drei Bundesländer betreut.

Die Geschichte ist bekannt. Die Cloud kam, war billiger, war besser, und ein Markt hat eine Auswahl getroffen. Das ist nicht skandalös, das ist Wettbewerb.

Was diese Geschichte heute interessant macht, ist nicht der Verlust an sich. Es ist die Frage, was passiert, wenn die Schicht, gegen die der Markt sich entschieden hat, nicht mehr da ist. Und der Markt sich umentscheiden möchte.

Inhalt

- Was die Cloud tatsächlich geleistet hat

- Die Schicht unter der Cloud heißt Broadcom

- AWS bricht das eigene Versprechen

- Die Migration zurück existiert nur theoretisch

- Predatory Pricing hat einen Namen, weil es ein Muster ist

- Hybrid ist die Antwort, die nach Arbeit klingt

- Was der Dealer-Vergleich heute bedeutet

Was die Cloud tatsächlich geleistet hat

Bevor ich zur Pointe komme, gehört die ehrliche Würdigung an den Anfang.

Was AWS, Azure und Google Cloud in fünfzehn Jahren gebaut haben, ist Engineering auf einem Niveau, das in keinem Mittelstands-Serverraum reproduzierbar ist. Verfügbarkeit über mehrere Regionen. Automatisches Failover. Skalierung von einer Anfrage pro Stunde auf zehntausend pro Sekunde, ohne dass jemand morgens um drei aufstehen müsste. Datenbanken, die sich selbst replizieren. Object Storage, der praktisch nicht voll wird.

Die Mathematik hat ebenfalls funktioniert, jedenfalls am Anfang. Tausende Kunden teilen sich dieselbe Hardware. Spitzenlasten gleichen sich aus. Die Auslastung steigt von typischen zwanzig Prozent im eigenen Serverraum auf siebzig oder mehr. Wartung und Sicherheit werden professionalisiert. Wenn man Personalkosten ehrlich einrechnet, war Cloud für viele Anwendungsfälle billiger als die eigene Infrastruktur. Und ist es für viele Workloads bis heute.

Das ist die Folie, vor der das Systemhaus verschwand. Nicht aus Faulheit, nicht aus Inkompetenz. Es wurde unterboten, in einem Markt, der die kurzfristige Rechnung anders gewichtete als die langfristige Abhängigkeit. Das ist nicht moralisch zu verurteilen. Das ist erstmal nur Marktwirtschaft.

Die Frage ist, was passiert, wenn der Marktpreis sich ändert.

Die Schicht unter der Cloud heißt Broadcom

Im November 2023 schloss Broadcom die Übernahme von VMware ab. Neunundsechzig Milliarden Dollar. Eine der größten Software-Akquisitionen aller Zeiten. Was danach passierte, ist im Detail dokumentiert, und die Zahlen sollte man im Original lesen, weil sie sonst übertrieben klingen.

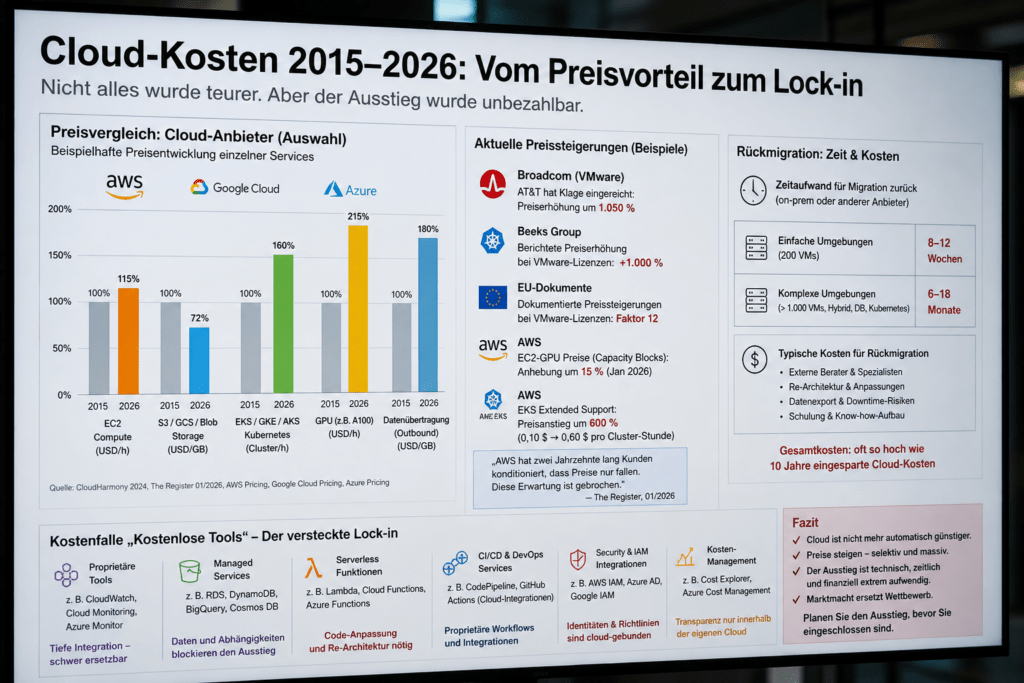

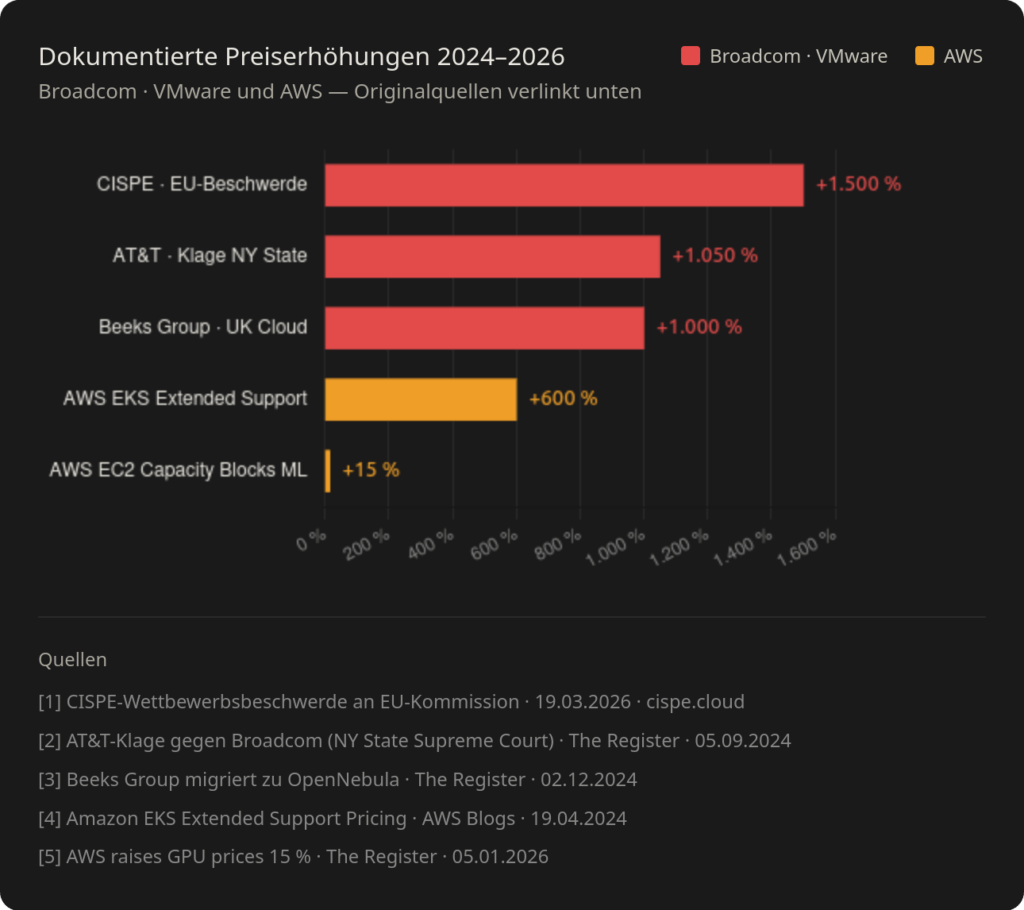

Broadcom schaffte unbefristete Lizenzen ab. Achttausend SKUs wurden auf vier Bundles reduziert. Wer VMware weiter nutzen wollte, musste in ein Abonnement-Modell wechseln, dessen Preise nicht mehr verhandelbar waren. AT&T zog vor Gericht und dokumentierte in der Klageschrift eine Preiserhöhung von 1.050 Prozent. Die britische Beeks Group, ein Cloud-Anbieter, meldete plus 1.000 Prozent und migrierte auf OpenNebula. Der europäische Cloud-Verband CISPE dokumentierte Erhöhungen bis zum zwölffachen Faktor und rief die EU-Kommission zum Eingreifen auf.

Konkret in Zahlen: Die VMware-Mindestlizenz nach Übernahme liegt bei rund 10.548 Euro pro Jahr. Die vergleichbare Proxmox-Basic-Lizenz kostet 1.770 Euro. Eine Ersparnis von 83 Prozent für funktional vergleichbare Virtualisierung. Gartner prognostiziert, dass bis 2028 etwa siebzig Prozent der VMware-Enterprise-Kunden mindestens fünfzig Prozent ihrer Workloads migrieren werden.

Die Frage ist, warum mich das in einem Artikel über Cloud-Preise interessieren sollte. Antwort: Weil VMware in Teilen unter den Cloud-Stacks selbst läuft. Weil viele Hosting-Provider, MSPs und Hybrid-Cloud-Anbieter VMware als Fundament hatten. Wenn die Schicht darunter um Faktor zehn teurer wird, kommt das oben an. Nicht morgen, aber in der nächsten Vertragsverhandlung.

Broadcom hat keine Cloud aufgekauft. Broadcom hat einen Hebel aufgekauft. Und das Geschäftsmodell, mit dem dieser Hebel jetzt bedient wird, hat einen Namen, zu dem ich gleich komme.

AWS bricht das eigene Versprechen

Der zweite Datenpunkt kommt aus dem eigenen Hause der Cloud-Anbieter.

AWS hat über zwei Jahrzehnte ein Versprechen gepflegt. Preise sinken. Skaleneffekte werden weitergegeben. Auf jeder re:Invent-Konferenz wurde ein Set neuer Preisreduzierungen feierlich vorgestellt. Der eigene Marketing-Sprech enthielt den Satz, AWS gebe gewonnene ökonomische Effizienz an Kunden zurück. Das war über lange Zeit empirisch nachweisbar.

Im April 2024 wurde der Hourly-Preis für EKS-Cluster mit Kubernetes-Versionen im Extended Support von 0,10 auf 0,60 Dollar erhöht. Sechshundert Prozent. AWS begründete das mit dem Aufwand, ältere Versionen weiter zu pflegen. Die Argumentation ist nicht falsch. Sie war nur in fünfzehn Jahren AWS-Geschichte nicht das übliche Muster.

Im Januar 2026 hob AWS die Preise für EC2 Capacity Blocks für ML um etwa fünfzehn Prozent an. Eine p5e.48xlarge-Instanz mit acht NVIDIA-H200-GPUs sprang von 34,61 auf 39,80 Dollar pro Stunde. In US West (N. California) stieg derselbe Instanztyp von 43,26 auf 49,75 Dollar. Die Erhöhung kam ohne große Ankündigung an einem Samstag. Bemerkenswert wurde sie, weil rund sieben Monate vorher dieselben Instanztypen mit großem Aufwand als billiger vermarktet worden waren, und weil Capacity Blocks in der damaligen Pressemitteilung bewusst nicht erwähnt wurden.

The Register hat den entscheidenden Satz dazu geschrieben. Frei übersetzt: AWS hat zwei Jahrzehnte lang Kunden konditioniert, dass Preise nur fallen. Diese Erwartung ist gebrochen. Wenn man einmal die Preise in einem Service erhöht hat und die Welt nicht untergeht, wird die zweite Erhöhung leichter. Und die dritte.

Das ist die strukturelle Beobachtung. Es geht nicht um eine einzelne Preiserhöhung. Es geht um den Wechsel des Musters. Die Annahme, dass Cloud-Preise nur in eine Richtung wandern, war nie Naturgesetz. Sie war Marketing-Disziplin. Wenn diese Disziplin endet, weil ein Wettbewerber etwas gewagt hat oder weil eine GPU-Knappheit den Hebel groß genug erscheinen lässt, ändert sich der Bezugsrahmen für jede Cloud-Kalkulation.

Die Migration zurück existiert nur theoretisch

An dieser Stelle würde ein Mittelständler mit Bauchschmerzen die naheliegende Frage stellen. Wenn die Cloud teurer wird, gehe ich eben zurück. Es gab schließlich mal Server in meinem Keller. Es gab mal jemanden, der sie betreute.

Die Antwort steht im Detail. Migrationsberater schätzen den Aufwand für ein typisches Mittelstands-Setup mit 50 bis 200 virtuellen Maschinen auf 8 bis 12 Wochen, wenn die Migration strukturiert geplant ist. Komplexe Enterprise-Umgebungen mit tausenden VMs benötigen 6 bis 18 Monate. Diese Zahlen kommen aus Migrationen, die bereits stattgefunden haben, also dokumentiertes Erfahrungswissen.

Die zweite Antwort ist die unangenehmere. Diese Wochen und Monate setzen voraus, dass es jemanden gibt, der die Migration begleitet. Einen Dienstleister mit Personal, das die Quell- und die Zielumgebung versteht. Genau dieser Markt ist in den letzten zehn Jahren ausgedünnt worden. Die Systemhäuser, die solche Migrationen früher als Routine begleitet hätten, existieren nicht mehr in der Dichte, in der sie 2010 existierten. MSPs sind eine Antwort, aber sie sind nicht räumlich präsent, sie sind nicht persönlich verbunden, und sie sind teurer als die Systemhäuser je waren.

Die strukturelle Asymmetrie liegt offen. Die Migration in die Cloud dauerte für viele Unternehmen mehrere Jahre und wurde von einem reifen Beratermarkt begleitet. Die Migration zurück müsste in vergleichbarer Zeit geschehen, mit einem geschrumpften Beratermarkt, gegen einen Cloud-Anbieter, der wenig Interesse hat, den Ausstieg leicht zu machen. Datentransfer-Egress-Kosten waren über Jahre der größte Kassenschlager der Hyperscaler. Die meisten Cloud-Verträge haben Klauseln, die einen ungeordneten Ausstieg zumindest verteuern.

Das ist das Geschäftsmodell. Das ist nichts, was Anbieter verheimlichen. Es steht in jedem ehrlichen Cloud-Architektur-Buch der letzten zehn Jahre. Die Frage ist, warum trotzdem so wenig Mittelständler die Konsequenzen daraus gezogen haben, bevor das Vakuum auf der Gegenseite entstand.

Predatory Pricing hat einen Namen, weil es ein Muster ist

Was die Cloud-Anbieter über fünfzehn Jahre gemacht haben, hat in der Wirtschaftswissenschaft einen etablierten Namen. Predatory Pricing. Übersetzt etwa: räuberische Preisgestaltung. Die Strategie besteht aus zwei Phasen. Phase eins: Preise unterhalb der eigenen Kosten anbieten oder zumindest so weit unten, dass der Wettbewerb nicht mithalten kann. Phase zwei: Wenn der Wettbewerb verschwunden ist, die Preise auf das Niveau anheben, das der Markt nun zu zahlen bereit ist, weil keine Alternative mehr existiert.

Predatory Pricing ist in den meisten Industrieländern wettbewerbsrechtlich problematisch. In den USA ist es nach dem Sherman Act in extremen Fällen verfolgbar. In der EU regelt Artikel 102 AEUV den Missbrauch marktbeherrschender Stellungen. In der Praxis ist es schwer nachzuweisen, weil die ursprüngliche Niedrigpreisphase als Wettbewerb deklariert werden kann und die spätere Hochpreisphase als Marktanpassung. Beide Begriffe stimmen formal. Sie ergeben zusammen aber das Muster, vor dem das Wettbewerbsrecht eigentlich schützen soll.

Das Bild des Dealers, das im Volksmund existiert, beschreibt dasselbe Muster. Der erste Schuss ist umsonst. Der zweite ist günstig. Der dritte ist normal bepreist. Der vierte ist teuer, aber zu diesem Zeitpunkt hat der Kunde keine andere Option mehr. Der Dealer hat nichts Illegales getan in der ersten Phase. Er hat geschenkt. Was illegal wäre, lässt sich erst beurteilen, wenn man den ganzen Verlauf betrachtet.

Ich vergleiche Cloud-Anbieter ausdrücklich nicht mit Drogendealern. Das wäre billig und unrichtig. Was ich sage, ist, dass das ökonomische Muster in beiden Fällen denselben Namen trägt. Initiale Subvention. Konsolidierung der Abhängigkeit. Extraktion in der späteren Phase. Wer dieses Muster bei einem Cloud-Anbieter erkennt, hat keine Verschwörungstheorie aufgestellt. Er hat ein Standardlehrbuch der Industrieökonomie gelesen.

Die Reaktion darauf ist nicht Empörung. Die Reaktion darauf ist Architektur, die diesen Hebel nicht zulässt.

Hybrid ist die Antwort, die nach Arbeit klingt

Was folgt aus all dem? Eine pauschale Cloud-Verweigerung wäre die falsche Schlussfolgerung. Sie würde die echte Engineering-Leistung der Anbieter ignorieren. Sie würde Mittelständler, die längst in Cloud-Strukturen produktiv arbeiten, in eine Re-Migration drängen, die sie nicht stemmen können. Und sie würde die Trennlinie verfehlen, an der das eigentliche Problem liegt.

Die saubere Antwort heißt Klassifikation. Welche Daten haben Sie? Welche Workloads laufen? Was davon ist generisch, austauschbar, unkritisch? Und was davon ist Tafelsilber?

Eine Marketing-Webseite gehört in die Cloud. Ein Build-Server für Open-Source-Projekte gehört in die Cloud. Eine Telemetrie-Pipeline für anonymisierte Produktnutzung gehört in die Cloud. Diese Workloads sind das, wofür Cloud erfunden wurde. Sie sind austauschbar zwischen Anbietern, sie sind nicht geschäftskritisch in dem Sinne, dass eine Preiserhöhung um Faktor zehn das Unternehmen ruinieren würde.

Die Mandantenakte gehört nicht in die Cloud. Die Patientendokumentation gehört nicht in die Cloud. Die ungeprüfte Steuererklärung gehört nicht in die Cloud. Der Quellcode mit Geschäftsgeheimnis-Charakter gehört nicht in die Cloud. Verhandlungsstrategien gehören nicht in die Cloud. Diese Daten erfüllen zwei Eigenschaften gleichzeitig: Sie sind sensibel, und sie sind geschäftskritisch im engen Sinn. Eine Preiserhöhung beim Anbieter, ein Souveränitätsverlust durch CLOUD Act, ein Datenleck durch eine Konfigurationspanne, jedes dieser Risiken trifft den Kern des Unternehmens.

Hybrid ist die Antwort, die niemand gerne ausspricht, weil sie nach Arbeit klingt. Sie verlangt eine Klassifikation. Sie verlangt unterschiedliche Infrastrukturen für unterschiedliche Workloads. Sie verlangt ein technisches Verständnis, das im eigenen Haus oder bei einem verlässlichen Partner vorgehalten werden muss. Sie verlangt also genau das, wofür es früher einmal Systemhäuser gab.

Wer nach so einem Partner sucht, wird ihn finden. Es gibt sie noch, vereinzelt, oft mit einem Geschäftsführer, der den Markteinbruch der 2010er Jahre überlebt hat. Sie sind teurer als die Cloud-Aufnahme im Onboarding-Prozess war. Sie sind dafür da, wenn am Freitagnachmittag das Backup nicht durchläuft.

Was der Dealer-Vergleich heute bedeutet

Der Spruch von 2014, dass die Cloud klaut, war damals eine Übertreibung. Die meisten Datenverluste waren Konfigurationsfehler, schwache Passwörter, der iCloud-Promi-Leak. Die strukturellen Risiken einer Cloud-Abhängigkeit lagen weitgehend in der Theorie.

Heute lassen sich die Phasen empirisch beobachten. Die initiale Subventionsphase liegt hinter uns. Die Konsolidierungsphase ist abgeschlossen. Drei Hyperscaler teilen sich rund siebzig Prozent des globalen Cloud-Markts. Die Schicht der lokalen IT-Dienstleister, die als Alternative hätte dienen können, ist ausgedünnt. Die Extraktionsphase hat begonnen, leise zunächst, mit einzelnen Erhöhungen, mit Pattern-Brüchen, mit Ankündigungen, die an einem Samstag kommen.

Die richtige Frage ist nicht mehr, ob man in die Cloud geht oder nicht. Die richtige Frage ist, welche Architektur man baut, damit der Hebel der Anbieter nicht zu lang wird. Welche Workloads man austauschbar hält, mit Multi-Cloud oder Containerisierung oder offenen Standards. Welche Workloads man im eigenen Haus hält, weil ihre Sensibilität oder ihre Kritikalität es verlangt. Und welche Partner man kennt, die einen begleiten, wenn die nächste Migrationsentscheidung fällig wird.

Das Systemhaus, das in deiner Stadt fehlt, ist die Konsequenz einer kollektiven Entscheidung, die niemand bewusst getroffen hat. Jeder einzelne Mittelständler hat in den 2010er Jahren eine rationale individuelle Entscheidung gefällt. Im Aggregat hat dieser Markt seine eigene Alternative zerlegt. Das Bedauern darüber bringt sie nicht zurück. Was bleibt, ist die Lehre für die nächste Architekturentscheidung.

Wer heute eine KI-Architektur aufbaut, sollte sich diese Geschichte ansehen, bevor er Klartext seiner Mandanten in eine fremde Inferenz-Pipeline schickt. Predatory Pricing setzt voraus, dass es einen Hebel gibt. Eine Architektur, die diesen Hebel nicht zulässt, ist die einzige Versicherung gegen die zweite Phase.

Architektur statt Versprechen. Diesmal nicht für die Datensouveränität, diesmal für die ökonomische Souveränität. Beide haben dasselbe Fundament. Beide werden von denselben Anbietern beworben, die einen guten Grund haben, sie nicht zu erfüllen.⛵

Quellen

[1] AT&T-Klage gegen Broadcom, The Register, 05.09.2024

https://www.theregister.com/2024/09/05/att_sues_broadcom_vmware_support

[2] Beeks Group migriert auf OpenNebula, The Register, 02.12.2024

https://www.theregister.com/2024/12/02/beeks_group_vmware_opennebula_migration

[3] CISPE Wettbewerbsbeschwerde gegen Broadcom, 19.03.2026

https://www.cispe.cloud/cispe-files-competition-complaint-against-broadcom

[4] Amazon EKS Extended Support Pricing, AWS Blogs, 19.04.2024

https://aws.amazon.com/blogs/containers/amazon-eks-extended-support-for-kubernetes-versions-pricing

[5] AWS raises GPU prices 15% on a Saturday, The Register, 05.01.2026

https://www.theregister.com/2026/01/05/aws_price_increase